Clientes cloud precisam entrar em contato com o time de Cloud informando a empresa (Produção ou homologação) código do projeto Analytics (Recebido no convite de ativação), tenant da empresa e período desejado para que seja realizado a importação dos dados. |

Para a correta importação dos dados das solicitações de processos customizados que possuem mais de uma versão, o importador fará a verificação da existência do evento beforeSendData(). Caso o importador encontre na implementação desse evento, respectivamente, a declaração de campos ou fatos personalizados, ele criará os arquivo necessários para o envio destes dados automaticamente. O código dentro do evento deve seguir o formato abaixo:

Sendo que "customFields[0]" é responsável pelo envio de dados tipo texto, e "customFacts[0]" pelo envio de dados do tipo numérico. Caso existam campos que utilizem funções específicas (split, por exemplo) para a definição do seu valor, o campo não será considerado nesta criação automática do arquivo. |

Para a consulta do envio de dados, siga os passos abaixo:

|

Para o processo de importação, não é preciso parar o serviço do fluig (este procedimento pode ser realizado enquanto o TOTVS Fluig Plataforma está em execução).

Primeiramente, será necessário efetuar o download do artefato correspondente à atualização da plataforma para o qual o importador será executado, disponível aqui.

Informamos que este importador de dados é compatível com as versões: 1.7.1 e inferiores. |

Para as versões 1.8.0 e superiores o importador compatível pode ser baixado aqui.

Após efetuar o download, a importação de dados históricos pode ser realizada de duas formas. Segue abaixo:

Caso o erro abaixo seja exibido na execução do importador, significa que o arquivo de validação do modo de startup do Wildfly não foi gerado e será necessário cria-lo manualmente.

Para isso:

|

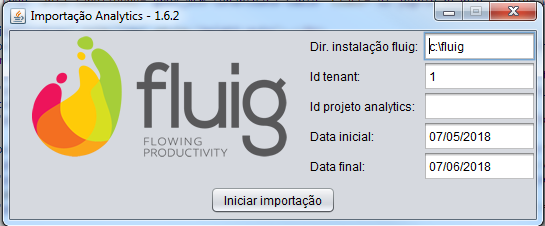

Execute o importador com um duplo clique ou via linha de comando (substituindo <VERSION> pele versão do importador):

java -jar analytics-import-<VERSION>.jar |

java -jar analytics-import-<VERSION>.jar <INSTALACAO_FLUIG> <ID_TENANT> <ID_PROJETO> <DATA_INICIAL> <DATA_FINAL> |

java -jar analytics-import-1.6-v3.jar c:\fluig 1 abc123def456ghi789jkl012mno345pq 10/01/2017 10/02/2017 |

O formato da data informada deverá ser DD/MM/AAAA |

1.Coloque o importador dentro do diretório raiz da instalação da plataforma.

2.Execute o importador informando os seguintes parâmetros na linha de comando:

java -jar analytics-import-<VERSION>.jar <INSTALACAO_FLUIG> <ID_TENANT> <ID_PROJETO> <DATA_INICIAL> <DATA_FINAL> gerar |

java -jar analytics-import-1.6-v3.jar c:\fluig 1 abc123def456ghi789jkl012mno345pq 10/01/2017 10/02/2017 gerar |

O formato da data informada deverá ser DD/MM/AAAA |

1.Coloque o importador dentro do diretório raiz da instalação da plataforma.

2.Execute o importador informando os seguintes parâmetros na linha de comando:

java -jar analytics-import-<VERSION>.jar <INSTALACAO_FLUIG> <ID_TENANT> <ID_PROJETO> <DATA_INICIAL> <DATA_FINAL> enviar |

java -jar analytics-import-1.6-v3.jar c:\fluig 1 abc123def456ghi789jkl012mno345pq 10/01/2017 10/02/2017 enviar |

O formato da data informada deverá ser DD/MM/AAAA |

1.Coloque o importador dentro do diretório raiz da instalação da plataforma.

2.Execute o importador informando os seguintes parâmetros na linha de comando:

java -jar analytics-import-<VERSION>.jar <INSTALACAO_FLUIG> <ID_TENANT> <ID_PROJETO> deletar <DATASET> |

java -jar analytics-import-1.6-v3.jar c:\fluig 1 abc123def456ghi789jkl012mno345pq deletar dataset.solicitacao |

Segue datasets válidos:

Ao término da execução do processo de importação, será gerado um log no diretório onde o arquivo analytics-import.jar foi executado.

1.Coloque o importador dentro do diretório raiz da instalação da plataforma.

2.Execute o importador informando os seguintes parâmetros na linha de comando:

java -jar analytics-import-<VERSION>.jar <INSTALACAO_FLUIG> <ID_TENANT> <ID_PROJETO> <DATA_INICIAL> <DATA_FINAL> gerar true SCHEMA |

java -jar analytics-import-1.6-v3.jar c:\fluig 1 abc123def456ghi789jkl012mno345pq 10/01/2017 10/02/2017 gerar true SCHEMA |

Este recurso faz com que os eventos beforeSendData das solicitações sejam executados mapeando os campos dos formulários. Os eventos só irão simular a execução de eventos com hAPI.getCardValue("Campo") e hAPI.getCardData() e gerar logs, outros métodos não serão executados.

O parâmetro SCHEMA só é necessário em bases ORACLE, caso contrário há a possibilidade de causar erro nos importadores.

Após a execução neste modo, um log contendo quais eventos foram executados com sucesso e com erro serão exibidos, bem como o select para pesquisar cada registro que o importador utilizou para enviar dados de formulários, sendo bem mais fácil verificar o acontecimento de erros e inconsistências.